Сегодня Microsoft заявила , что выпустила “самые мощные и экономичные из доступных языковых моделей малого размера (SLM)”, заявив, что Phi-3 - третья итерация своего семейства языковых моделей малого размера Phi (SLM) — превосходит модели сопоставимого размера и несколько более крупных.

Модель малого языка (SLM) - это тип модели искусственного интеллекта, который разработан для чрезвычайно эффективного выполнения определенных задач, связанных с языком. В отличие от больших языковых моделей (LLM), которые хорошо подходят для широкого спектра общих задач, SLM построены на меньшем наборе данных, что делает их более эффективными и экономичными для конкретных случаев использования.

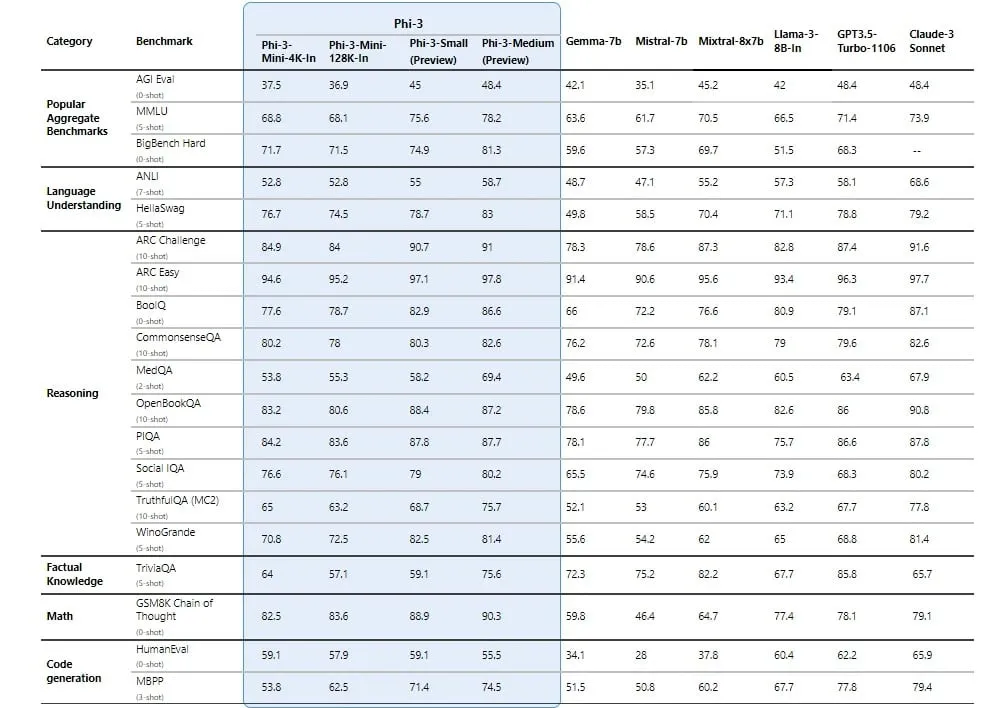

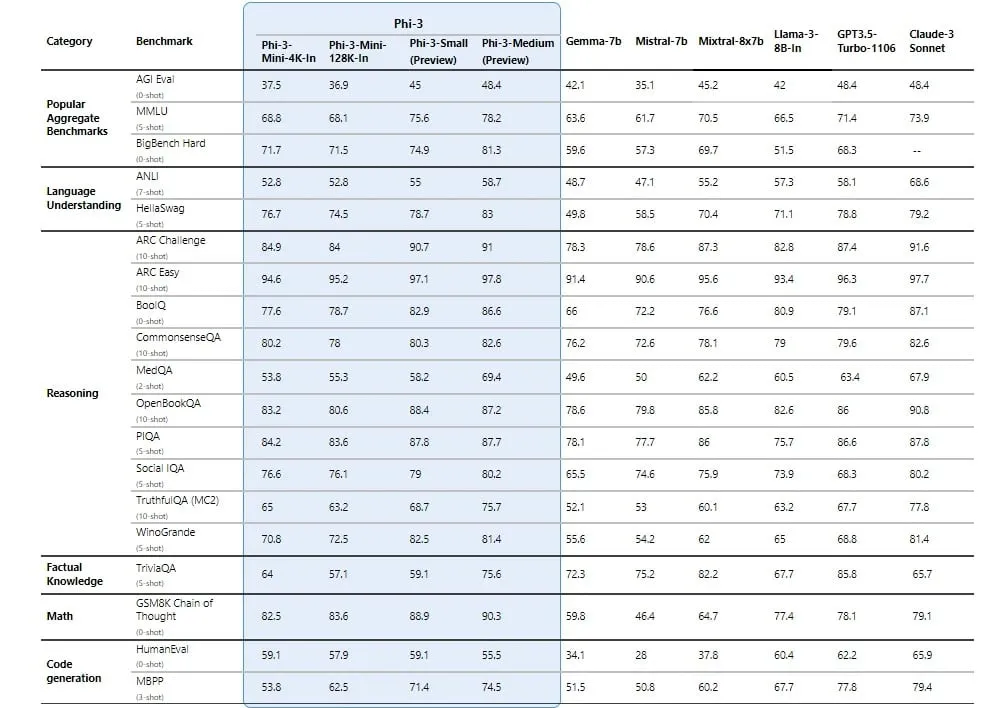

Как пояснили в Microsoft, Phi-3 поставляется в разных версиях, самой маленькой из которых является Phi-3 Mini, модель с 3,8 миллиардами параметров, обученная на 3,3 триллионах токенов. Несмотря на сравнительно небольшой размер — корпус Llama-3 весит более 15 трлн токенов данных — Phi-3 Mini по-прежнему способен обрабатывать 128 тыс. токенов контекста. Это делает ее сопоставимой с GPT-4 и превосходит Llama-3 и Mistral Large по емкости токенов.

Другими словами, гиганты искусственного интеллекта, такие как Llama-3 на Meta.ai и Mistral Large, могут выйти из строя после длительного общения или запроса задолго до того, как эта легкая модель начнет испытывать трудности.

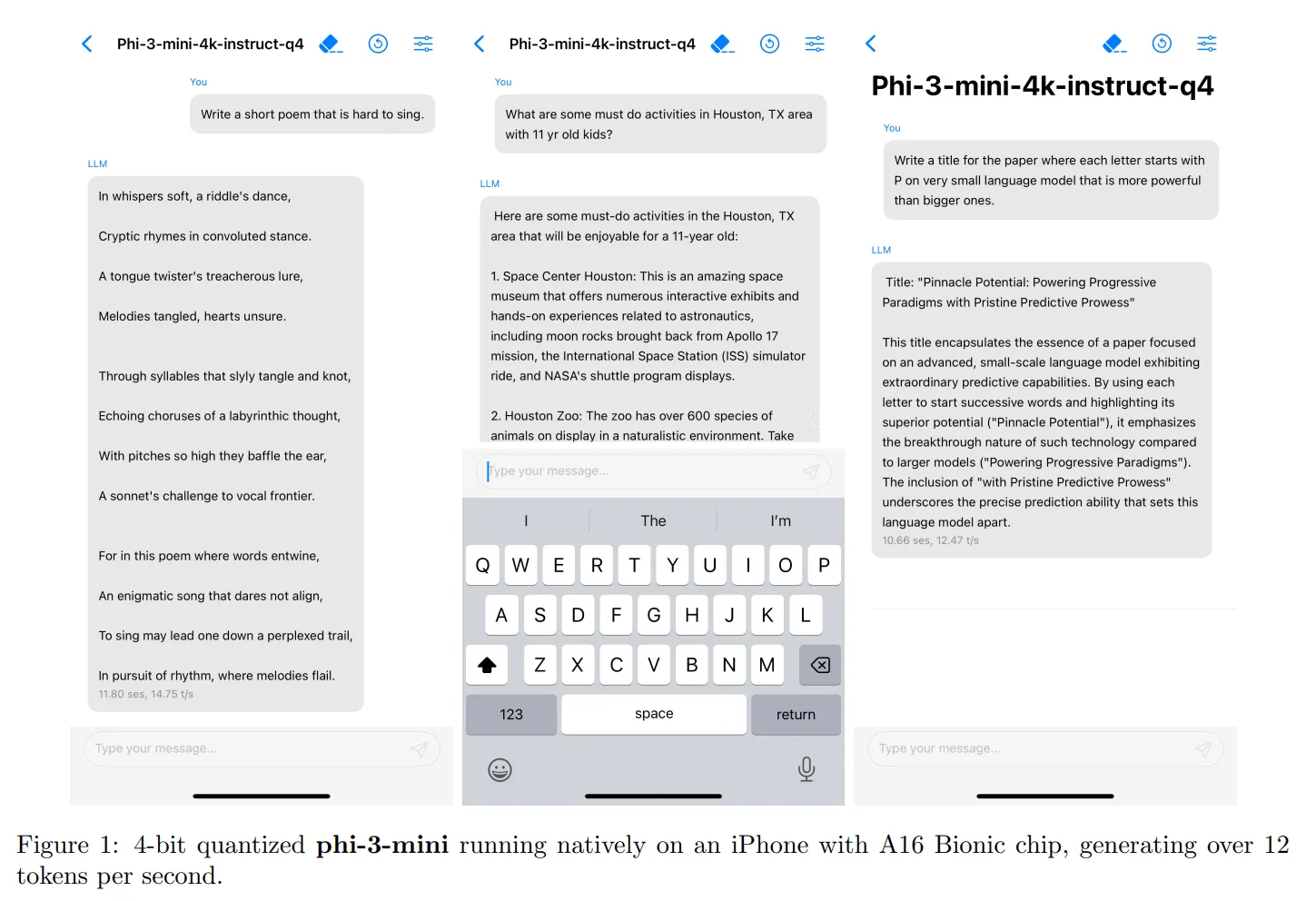

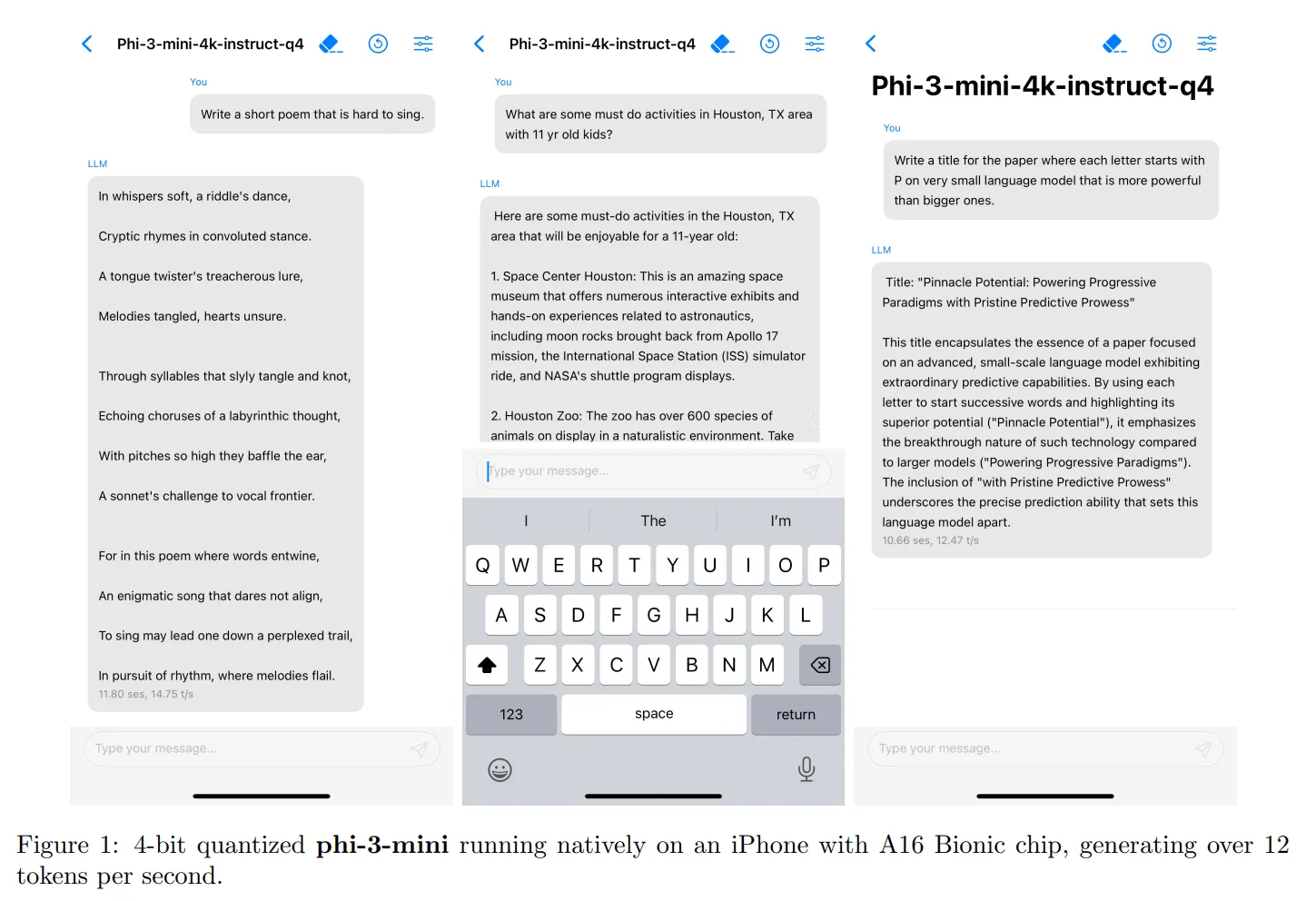

Одним из наиболее значительных преимуществ Phi-3 Mini является его возможность установки и запуска на обычном смартфоне. Microsoft протестировала модель на iPhone 14, и она работала без проблем, генерируя 14 токенов в секунду. Для работы Phi-3 Mini требуется всего 1,8 ГБ видеопамяти, что делает его легкой и эффективной альтернативой для пользователей с более узкими требованиями.

Хотя Phi-3 Mini может не подходить для высококлассных программистов или людей с широкими требованиями, она может стать эффективной альтернативой для пользователей с особыми потребностями. Например, стартапы, которым нужен чат-бот, или люди, использующие LLMS для анализа данных, могут использовать Phi-3 Mini для таких задач, как организация данных, извлечение информации, математические рассуждения и создание агентов. Если модели предоставить доступ в Интернет, она может стать довольно мощной, компенсируя недостаток возможностей информацией в режиме реального времени.

Phi-3 Mini набирает высокие баллы в тестах благодаря тому, что Microsoft уделяет особое внимание тому, чтобы в своих наборах данных содержалась как можно более полезная информация. Более широкое семейство Phi, по сути, не подходит для задач, требующих фактических знаний, но высокие навыки рассуждения ставят их выше основных конкурентов. Phi-3 Medium (модель с 14 миллиардами параметров) неизменно превосходит мощные модули управления, такие как GPT-3.5 — модуль управления, обеспечивающий работу бесплатной версии ChatGPT, - а мини-версия превосходит мощные модели, такие как Mixtral-8x7B, в большинстве синтетических тестов.

Однако стоит отметить, что Phi-3 не имеет открытого исходного кода, как его предшественник Phi-2. Вместо этого это открытая модель, что означает, что она доступна для использования, но у нее нет такого же лицензирования с открытым исходным кодом, как у Phi-2, что позволяет использовать ее более широко и в коммерческих приложениях.

В ближайшие недели Microsoft заявила, что выпустит больше моделей семейства Phi-3, включая Phi-3 Small (7 миллиардов параметров) и вышеупомянутую Phi-3 Medium.

Microsoft сделала Phi-3 Mini доступным в Azure AI Studio, Hugging Face и Ollama. Модель настроена с учетом инструкций и оптимизирована для среды выполнения ONNX с поддержкой Windows DirectML, а также кроссплатформенной поддержкой различных графических процессоров и даже мобильного оборудования.

"

"