Технология многое сделала, чтобы помочь в тех моментах, когда у вас на кончике языка вертится название мелодии. Благодаря ИИ теперь вам даже не нужно петь или напевать песню — просто подумайте об этом.

Это будущее, к которому стремятся ученые после прорывного исследования, успешно использовавшего искусственный интеллект (ИИ) для воссоздания музыки просто путем сканирования активности мозга, пока они думали о песне.

В статье, опубликованной в PLOS Biology, исследователи под руководством Калифорнийского университета в Беркли смогли сгенерировать узнаваемый звук песни Pink Floyd "Another Brick in the Wall, Part 1", используя только данные мозга.

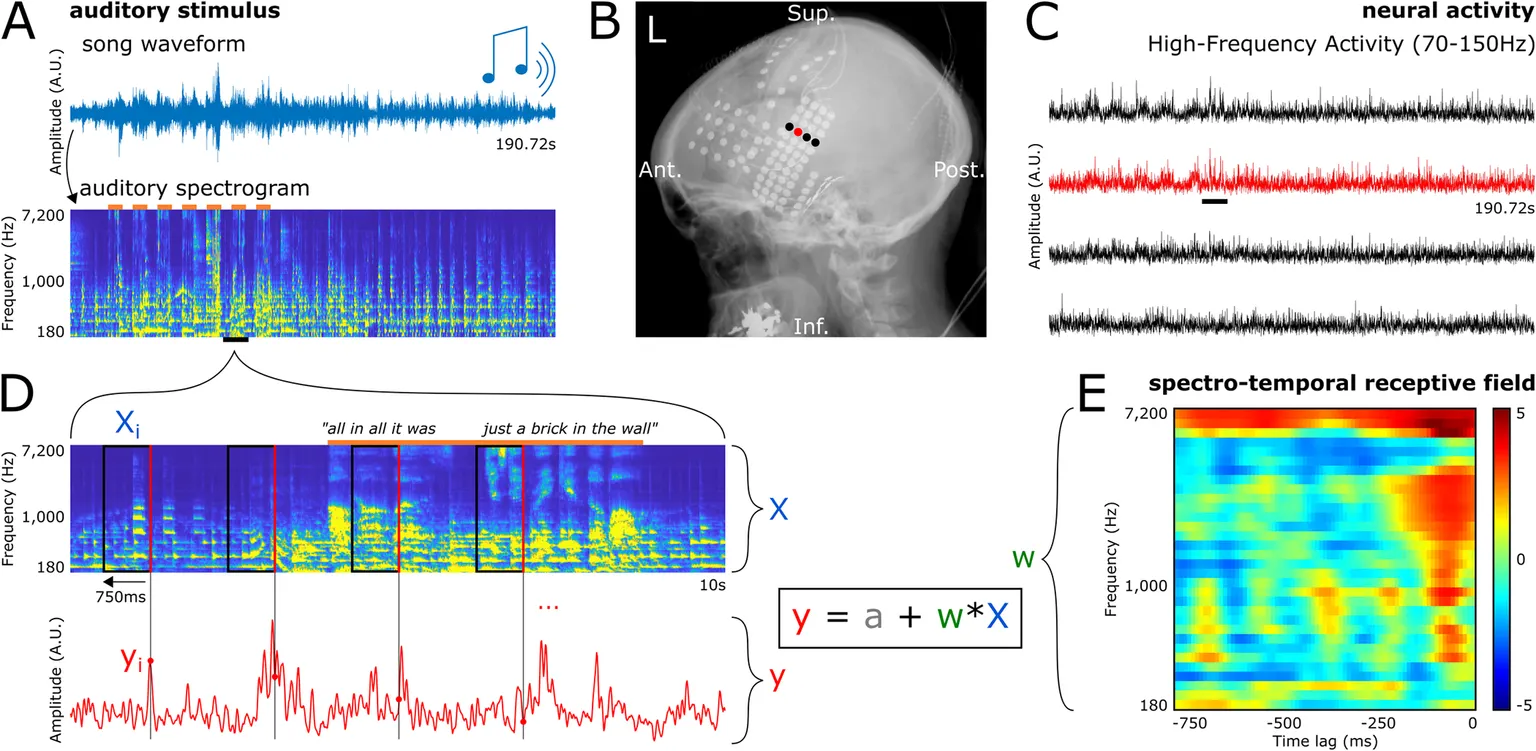

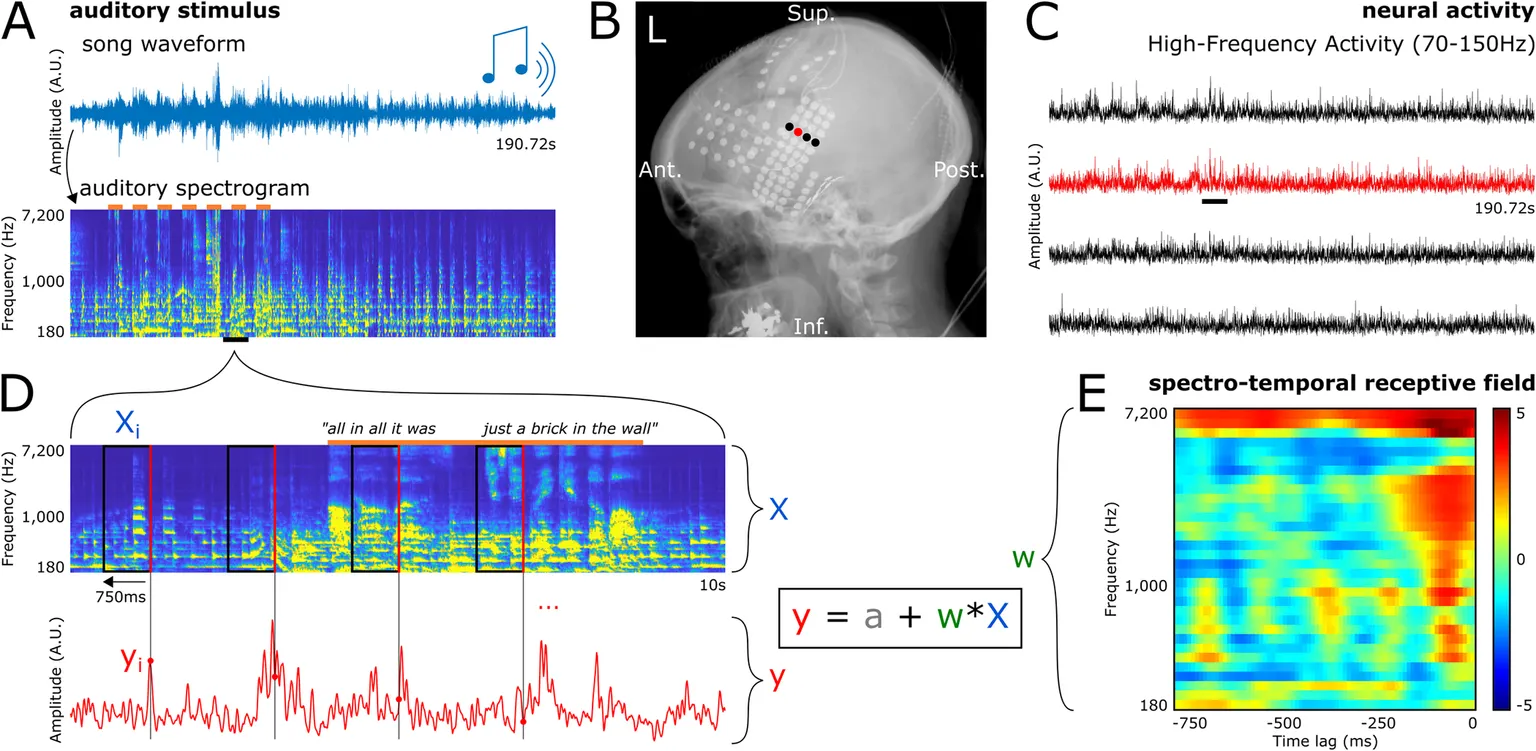

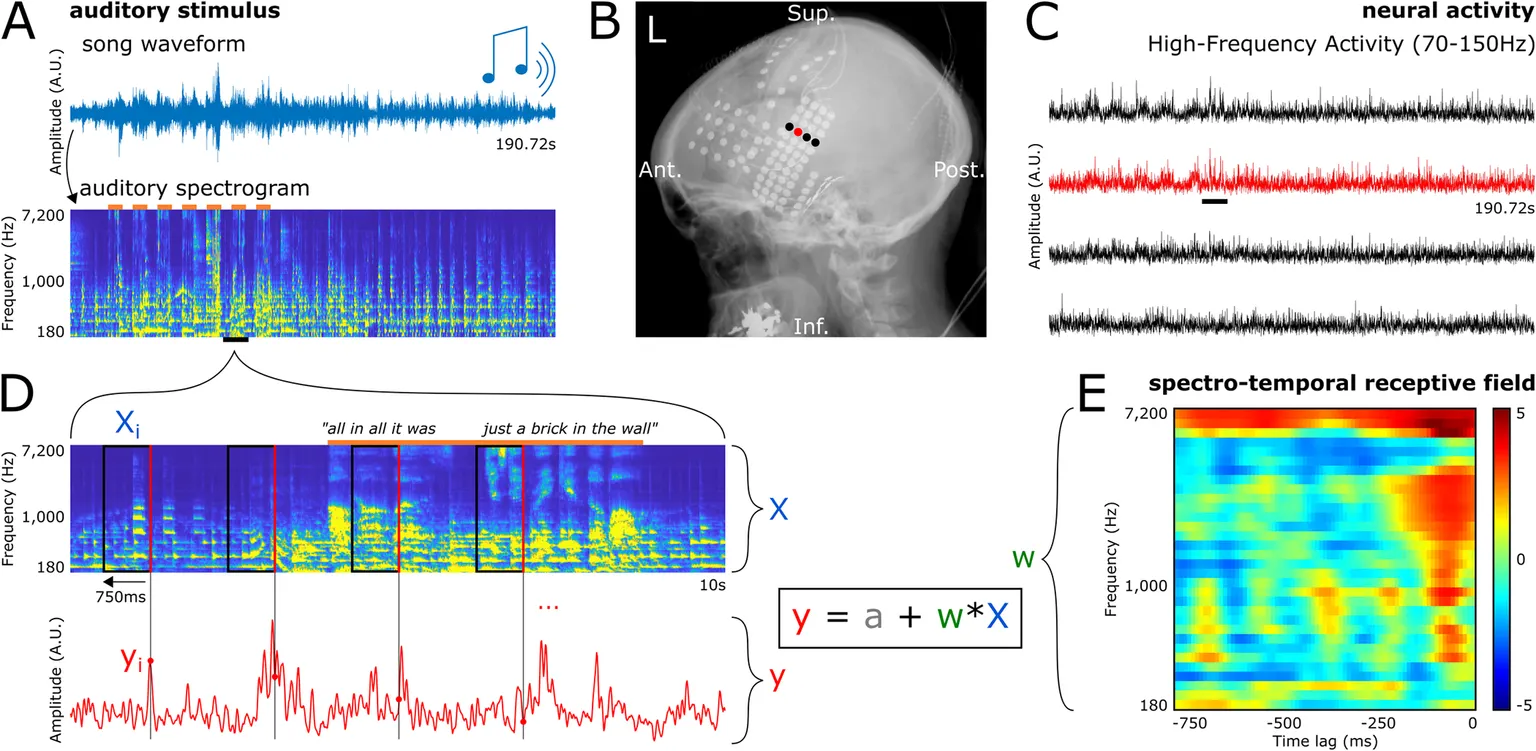

Исследование включало запись электрических сигналов непосредственно из мозга пациентов с эпилепсией, которые уже проходят мониторинг для лечения приступов. Когда пациенты пассивно слушали классическую рок-песню, электроды на поверхности их мозга фиксировали активность областей обработки слуховых сигналов.

Затем исследователи внедрили этот набор данных о мозге в алгоритмы машинного обучения. Анализируя закономерности реакции различных областей слуховой коры на такие компоненты, как высота звука, темп, вокал и инструменты, модели искусственного интеллекта научились связывать специфическую нейронную активность с определенными акустическими особенностями.

После обучения этим парам ввода-ответа модели смогли генерировать новые спектрографические представления только из данных мозга. Затем исследователи преобразовали эти визуализации в сигналы, создавая звук, который, хотя и искаженный— явно напоминал "Еще один кирпич в стене, часть 1".

Были идентифицированы не только мелодия и текст, но и нейронное декодирование даже отражало, какие инструменты вызывали определенные реакции в разных областях мозга. Например, активность в определенных частях верхней височной извилины колебалась конкретно в ответ на вокальные слоги. Между тем, другие области активировались больше в ответ на устойчивые ритм-гитарные мотивы песни.

Это демонстрирует способность разбивать сложный музыкальный стимул на составные части, основываясь исключительно на обработке мозга. Если это подтвердится будущими исследованиями, это станет огромным скачком вперед в расшифровке мыслей, поскольку предыдущие методы были ограничены отдельными словами или буквами.

Старший автор, нейробиолог из Калифорнийского университета в Беркли доктор Роберт Найт, объяснил, что команда выбрала песню Pink Floyd именно из-за ее богатой, многоуровневой инструментовки. Но этот подход может быть применен к любой музыке или даже к воспроизведению мелодических свойств естественной речи.

Исследователи предполагают, что эта технология в конечном итоге может быть использована, чтобы помочь тяжело парализованным пациентам или жертвам инсульта восстановить способность говорить, просто думая. Уже разрабатываются интерфейсы мозг-компьютер для расшифровки слов или текста по результатам неинвазивного сканирования мозга. Добавление размерности мелодии и просодии позволило бы более полно реконструировать мысли и предполагаемую речь.

Исследователи годами добивались прогресса в этой области чтения мыслей, а появление мощных моделей искусственного интеллекта (и аппаратного обеспечения) позволило увидеть крупные прорывы в этой области.

Не далее как в мае команда исследователей смогла превратить мысли в текст. "Мы были отчасти шокированы тем, что это работает так хорошо, как есть. Я работал над этим 15 лет... поэтому было шокирующе и захватывающе, когда это наконец сработало ", - сказал ведущий автор доктор Александр Хут, нейробиолог из Техасского университета в Остине.

Кроме того, Decrypt недавно сообщила, что медицинская команда успешно имплантировала микрочипы в мозг человека с параличом нижних конечностей и смогла использовать искусственный интеллект для восстановления ощущений и движений путем “(повторного подключения) его мозга к телу и спинному мозгу”.

"

"

"

"