Быстрый рост и потенциал преобразующего воздействия ИИ потребовали разработки комплексных стратегий и политики в области искусственного интеллекта, особенно в ведущих технологических странах, среди которых Великобритания, Европа и США.

Национальные стратегии и инициативы в области искусственного интеллекта в Великобритании, Европе и США.

Британская стратегия искусственного интеллекта

Национальная стратегия Великобритании в области искусственного интеллекта направленана использование искусственного интеллекта для повышения устойчивости, производительности, роста и инноваций. Великобритания нацелена на то, чтобы стать сверхдержавой в области искусственного интеллекта, и правительство поддерживает эту цель посредством инициатив, среди которых Сделка по сектору искусственного интеллекта стоимостью около 1 миллиарда британских фунтов. Подход стратегии является комплексным, включая развитие навыков в секторе искусственного интеллекта и создание благоприятной для инноваций нормативно-правовой среды.

В 2023 году правительство Великобритании представило новый подход к регулированию ИИ, уделив особое внимание безопасности, прозрачности и справедливости. Эта основанная на принципах структура призвана быть адаптируемой и ориентированной на будущее, избегая жесткого законодательства, которое может подавить инновации. Вместо единого централизованного регулятора ИИ существуют регуляторы, среди которых Управление здравоохранения и безопасности и Управление комиссара по информации, которые будут применять утвержденные принципы в своих сферах.

Закон ЕС об искусственном интеллекте

В Европе Европейский Союз предложил Закон об искусственном интеллекте , который представляет собой всеобъемлющую правовую основу для ИИ, уделяя особое внимание этической и безопасной разработке и использованию ИИ. Закон классифицирует системы искусственного интеллекта на основе риска и подчеркивает защиту безопасности и основных прав граждан. Его цель – предоставить четкие правовые рекомендации для бизнеса и способствовать инновациям, обеспечивая при этом соблюдение этических стандартов. Этот закон имеет важное значение для создания стандартизированного подхода к регулированию ИИ в Европейском Союзе.

Национальная инициатива США по искусственному интеллекту

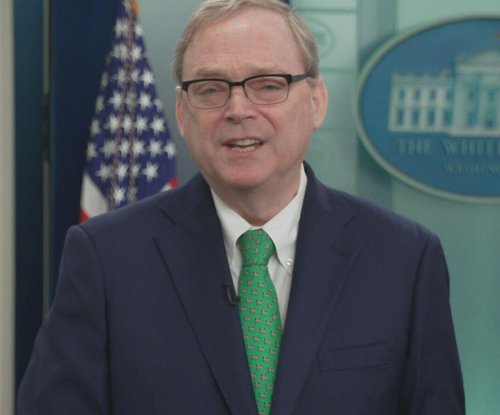

В США Национальная инициатива в области искусственного интеллекта продолжает уделять особое внимание содействию исследованиям и разработкам в области искусственного интеллекта и расширению сотрудничества между федеральными агентствами, частным сектором, научными кругами и международными партнерами.

Инициатива направлена на подготовку рабочей силы для экономики, основанной на искусственном интеллекте, и лидерство в разработке технических стандартов искусственного интеллекта во всем мире. В нем также подчеркивается важность разработки надежных, надежных и заслуживающих доверия систем искусственного интеллекта, подчеркивая важность искусственного интеллекта в стратегических интересах страны.

Регулирование этики, конфиденциальности и искусственного интеллекта в Великобритании, Европе и США.

В Великобритании этика ИИ формируется в соответствии с Рамками этики данных и руководящими принципами Института Алана Тьюринга, в которых особое внимание уделяется этической допустимости, справедливости, общественному доверию, «Ценностям SUM» (безопасность, беспристрастность и управляемость) и «Принципам FAST Track» (справедливость, подотчетность, устойчивость и прозрачность). Конфиденциальность данных регулируется принципами, аналогичными принципам Общего регламента защиты данных (GDPR) и Законопроекта о защите данных и цифровой информации 2022 года, что снижает нагрузку на предприятия по соблюдению требований.

Регулирование ИИ в Великобритании ориентировано на инновации, менее централизовано и основано на шести основных принципах в различных секторах. Подобное соответствует Национальной стратегии ИИ и Плану действий в области ИИ, чтобы сбалансировать инновации и общественное доверие.

Регулирование этики, конфиденциальности и искусственного интеллекта в ЕС

Закон ЕС об искусственном интеллекте гарантирует, что системы искусственного интеллекта в ЕС являются безопасными, прозрачными, отслеживаемыми, недискриминационными и экологически безопасными, с упором на человеческий контроль. Он стремится к единообразному определению ИИ и тесно интегрируется с принципами защиты данных ЕС, аналогично GDPR .

Закон классифицирует системы искусственного интеллекта по уровням риска: от высокого риска (например, тех, которые используются в критически важных секторах или затрагивают фундаментальные права) до неприемлемого риска, при котором запрещены вредные приложения искусственного интеллекта, особенно касающиеся социального рейтинга. Системы высокого риска подлежат строгой оценке и оценке воздействия на фундаментальные права.

Регулирование этики, конфиденциальности и искусственного интеллекта в США

В США регулирование ИИ сосредоточено на безопасности и защищенности: указ президента Джо Байдена от 2022 года требует раскрытия информации о тестах безопасности систем ИИ, которые могут повлиять на национальную безопасность или общественное благосостояние. Законодательные усилия по интеграции ИИ в различные сектора привели к внесению поправок в Закон о повторной авторизации Федерального авиационного управления (FAA) и Закон о развитии американского ИИ.

Американский закон о конфиденциальности и защите данных рассматривает определения и требования к системам искусственного интеллекта. Нормативно-правовая база развивается: такие агентства, как Национальный институт стандартов и технологий (NIST), устанавливают стандарты ИИ, а Федеральная торговая комиссия (FTC) контролирует влияние генеративного ИИ в секторах финансов и здравоохранения.

Исследования, разработки в области искусственного интеллекта и международная конкурентоспособность Великобритании, Европы и США

Исследования и разработки в области искусственного интеллекта быстро развиваются. Наблюдается прорыв в области машинного обучения , анализа данных и вычислительной мощности, при этом ключевыми тенденциями являются глубокое обучение и обработка естественного языка . Стратегия Великобритании в области искусственного интеллекта делает упор на фундаментальные модели и инновационные испытания в «песочнице», а программа национальных исследовательских институтов искусственного интеллекта США поддерживает межотраслевое исследовательское сотрудничество.

В глобальном масштабе конкурентоспособность искусственного интеллекта измеряется результатами исследований, инвестициями, привлечением талантливых специалистов и инфраструктурой, при этом лидируют США и ключевые европейские страны, среди которых Великобритания и Германия, поддерживаемые надежными технологическими экосистемами и государственной поддержкой.

Финансирование инноваций в области ИИ имеет решающее значение: США увеличивают федеральное финансирование и венчурные инвестиции, а Европа и Великобритания предлагают существенную поддержку через программы Horizon 2020, Horizon Europe и AI Sector Deal, стимулируя широкий спектр приложений ИИ и развитие бизнеса.

Применение искусственного интеллекта и международное сотрудничество

ИИ в политике государственного сектора

Интеграция ИИ в государственный сектор существенно изменила предоставление услуг, операционную эффективность и способность решать сложные социальные проблемы. В здравоохранении ИИ используется для диагностики заболеваний и планирования лечения , примером чему служат такие инициативы, как Национальная служба здравоохранения Великобритании, использующая ИИ для раннего выявления рака и управления уходом за пациентами.

В сфере транспорта ИИ помогает в управлении дорожным движением и регулировании беспилотных транспортных средств, как это видно на примере таких проектов в США, как исследование Министерства транспорта по использованию ИИ для улучшения транспортных систем.

Трансграничное сотрудничество в области искусственного интеллекта

Трансграничное сотрудничество в области искусственного интеллекта является ключом к использованию разнообразного опыта и ресурсов, стимулированию инноваций и решению глобальных проблем. Примером может служить сотрудничество ЕС и Японии по проектам похожим на AI4EU, который направлен на создание совместной исследовательской платформы в области искусственного интеллекта.

AI4EU — это проект, финансируемый ЕС и направленный на создание совместной экосистемы, ориентированной на искусственный интеллект, предоставляющей ресурсы, инструменты и поддержку для облегчения и ускорения исследований и инноваций в области искусственного интеллекта по всей Европе.

Государственно-частное партнерство в области искусственного интеллекта

Государственно-частное партнерство в области ИИ объединяет государственные ресурсы и инновации частного сектора для ускорения развития ИИ. Примером может служить британское соглашение по сектору искусственного интеллекта, которое предполагает сотрудничество между правительством и лидерами отрасли для расширения возможностей страны в области искусственного интеллекта. Другим примером является программа Национальных исследовательских институтов искусственного интеллекта США, партнерство между Национальным научным фондом, правительством, научными кругами и промышленностью, направленное на исследования искусственного интеллекта в различных областях.

Стандарты искусственного интеллекта и развитие рабочей силы

Стандарты и сертификация ИИ

Обеспечение безопасности, надежности и совместимости систем искусственного интеллекта имеет решающее значение, и стандарты и сертификаты искусственного интеллекта удовлетворяют эту потребность. Эти стандарты, разработанные международными организациями, отраслевыми группами и регулирующими органами, охватывают этические аспекты , обработку данных, прозрачность алгоритмов и безопасность. Например, серия IEEE P7000 предлагает принципы этического проектирования в области искусственного интеллекта.

Развитие рабочей силы ИИ

Квалифицированная рабочая сила в области ИИ необходима для полного использования потенциала ИИ. Университеты по всему миру предлагают специализированные программы в области искусственного интеллекта, машинного обучения и науки о данных. Онлайн-платформы, среди которых Coursera и edX , также демократизировали образование в области искусственного интеллекта, предоставляя доступные курсы в партнерстве с ведущими учреждениями.

Более того Google и Microsoft, проводят программы обучения ИИ для своих сотрудников, и предпринимают все более активные усилия по диверсификации рабочей силы в области ИИ, способствуя инклюзивности в разработке ИИ.

Правовые аспекты и аспекты безопасности ИИ

ИИ и интеллектуальная собственность (ИС)

Пересечение ИИ и права интеллектуальной собственности — сложная и развивающаяся область. Одним из ключевых вопросов является определение прав интеллектуальной собственности на контент и изобретения, созданные с помощью ИИ. Традиционным законам об интеллектуальной собственности приходится учитывать нюансы ИИ, что приводит к спорам о том, можно ли признать сами системы ИИ изобретателями или создателями.

Эти дебаты распространяются на различные юрисдикции: патентные ведомства, среди которых Европейское патентное ведомство (ЕПВ) и Ведомство США по патентам и товарным знакам (USPTO), пересматривают руководящие принципы, касающиеся роли ИИ в изобретениях. Ключевые аспекты дебатов включают в себя :

ИИ как изобретатель: имеют ли системы ИИ такое же признание, как и изобретатели-люди? Это ставит под сомнение традиционные идеи творчества и изобретательства, которые издавна ассоциировались с интеллектуальными усилиями человека.

Право собственности на изобретения, созданные ИИ: кто имеет право на интеллектуальную собственность, созданную системой ИИ? Статус ИИ и вопрос о том, должен ли создатель или оператор ИИ владеть интеллектуальной собственностью, являются еще одной проблемой, вызывающей обеспокоенность в связи с этим вопросом.

Право на получение патента и требования: Согласно действующим патентным правилам, изобретателями должны быть люди. В результате стандартные патентные требования, например, касающиеся изобретательства и творческого процесса, могут не распространяться на идеи, создаваемые системами искусственного интеллекта.

ИИ в национальной безопасности

Роль ИИ в национальной безопасности вызывает серьезные этические и юридические проблемы. Его применение в наблюдении, автономном оружии, кибербезопасности и анализе разведданных повышает обороноспособность, но также создает проблемы, связанные с автономией, конфиденциальностью и этичным использованием. Использование искусственного интеллекта для наблюдения вызвало дебаты о конфиденциальности и гражданских свободах, особенно относительно баланса между безопасностью и правами личности.

"

"