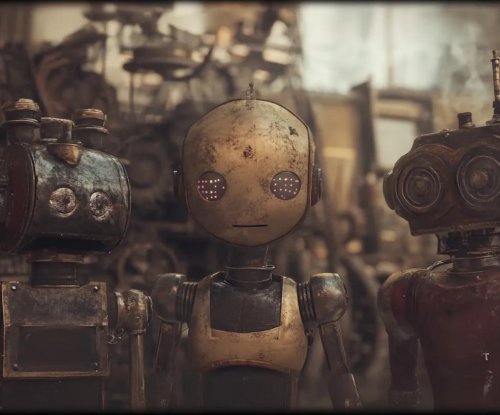

MolmoAct работает в три этапа, имитируя человеческий подход к планированию действий. Сначала модель анализирует визуальные данные, генерируя токены восприятия с учетом глубины — это позволяет оценивать расстояния между объектами и строить пространственную карту. Затем она создает план в виде последовательности waypoint'ов — визуальных траекторий в изображении, которые можно редактировать. Наконец, модель преобразует план в точные команды для роботов, такие как движение манипулятора или захват объекта.

Модель обучена на датасете из около 12 тысяч реальных "робот-эпизодов" — видео с задачами в домашних условиях, от сортировки мусора до расстановки предметов. Это обеспечивает высокую обобщаемость: MolmoAct показывает 70,5% точности в zero-shot задачах на SimplerEnv, опережая закрытые модели вроде π0 и GR00T N1. В бенчмарке LIBERO она достигает 86,6% успеха, с преимуществом в длинных задачах, а в реальных тестах улучшает прогресс на 10-22,7% по сравнению с базовыми моделями.

Одна из ключевых фишек — интерпретируемость: перед действием модель отображает траекторию на экране, позволяя человеку корректировать ее пальцем на смартфоне или планшете. Это делает систему безопасной и удобной для совместной работы с людьми.

Открытость и влияние на робототехнику

Ai2 подчеркивает полную открытость MolmoAct: выпущены веса модели, код обучения, датасеты и инструменты оценки. В отличие от "черных ящиков" вроде Gemini или GR00T, здесь все прозрачно, что ускоряет исследования и разработку. Модель адаптируется к разным роботам — от простых манипуляторов до гуманоидов — с минимальной донастройкой.

Разработчики видят в MolmoAct фундамент для embodied AI, где ИИ интегрируется в физические системы. Она уже демонстрирует превосходство в обобщении на новые сценарии, с +23,3% над базовыми моделями в out-of-distribution тестах. Это открывает двери для применения в повседневной жизни, от умных домов до спасательных операций.

Этические аспекты и перспективы

Внедрение MolmoAct поднимает вопросы о безопасности и доступности: прозрачность помогает избежать ошибок, но требует строгого контроля за использованием в критических областях. Критики отмечают риск неравенства, если такие технологии останутся прерогативой крупных игроков, но открытость Ai2 нивелирует это.

В будущем модель планируют расширить на большее количество сценариев, включая симуляции и мультимодальные данные. Ai2 продолжает традиции открытого ИИ, делая технологии доступными для всех. Вопрос в том, как такие модели изменят взаимодействие человека и машин, сделав роботов по-настоящему умными партнерами?

"

"