Подделки знаменитостей и мошеннические рекламные акции с использованием изображений обнаженных несовершеннолетнихБезудержное распространение подделок сопряжено со значительными рисками — от создания —способность отличать контент, созданный искусственным интеллектом (AIGC), от контента, созданного человеком, никогда не была столь важной.

Нанесение водяных знаков, распространенная мера борьбы с подделкой документов и денежных знаков, является одним из методов идентификации такого контента с добавлением информации, которая помогает отличить изображение, созданное искусственным интеллектом, от изображения, не созданного искусственным интеллектом. Но в недавнем исследовательском документе был сделан вывод, что простых или даже продвинутых методов нанесения водяных знаков может быть недостаточно для предотвращения рисков, связанных с публикацией материалов искусственного интеллекта как созданных человеком.

Исследование проводилось группой ученых из Наньянского технологического университета, S-Lab, NTU, Университета Чунцина, Шеннон.Искусственный интеллект и Чжэцзянский университет.

Один из авторов, Ли Гуаньлинь, сказал Decrypt, что "водяной знак может помочь людям узнать, создан ли контент искусственным интеллектом или людьми”. Но, добавил он, “Если водяной знак на AIGC легко удалить или подделать, мы можем свободно заставить других поверить, что художественное произведение создано искусственным интеллектом, добавив водяной знак, или AIGC создано людьми, удалив водяной знак".

В статье были рассмотрены различные уязвимости в современных методах нанесения водяных знаков.

"Схемы водяных знаков для AIGC уязвимы для атак противника, которые могут удалить водяной знак, не зная секретного ключа", - говорится в нем.

Эта уязвимость имеет реальные последствия, особенно в отношении дезинформации или злонамеренного использования контента, созданного искусственным интеллектом.

“Если некоторые злоумышленники распространят созданные искусственным интеллектом поддельные изображения некоторых знаменитостей после удаления водяных знаков, невозможно доказать, что изображения сгенерированы искусственным интеллектом, поскольку у нас нет достаточных доказательств", - сказал Ли Decrypt.

Ли и его команда провели серию экспериментов, проверяющих устойчивость и целостность существующих методов нанесения водяных знаков на контент, созданный искусственным интеллектом. Они применяли различные методы удаления или подделки водяных знаков, оценивая простоту и эффективность каждого метода. Результаты неизменно показывали, что водяные знаки могут быть скомпрометированы относительно легко.

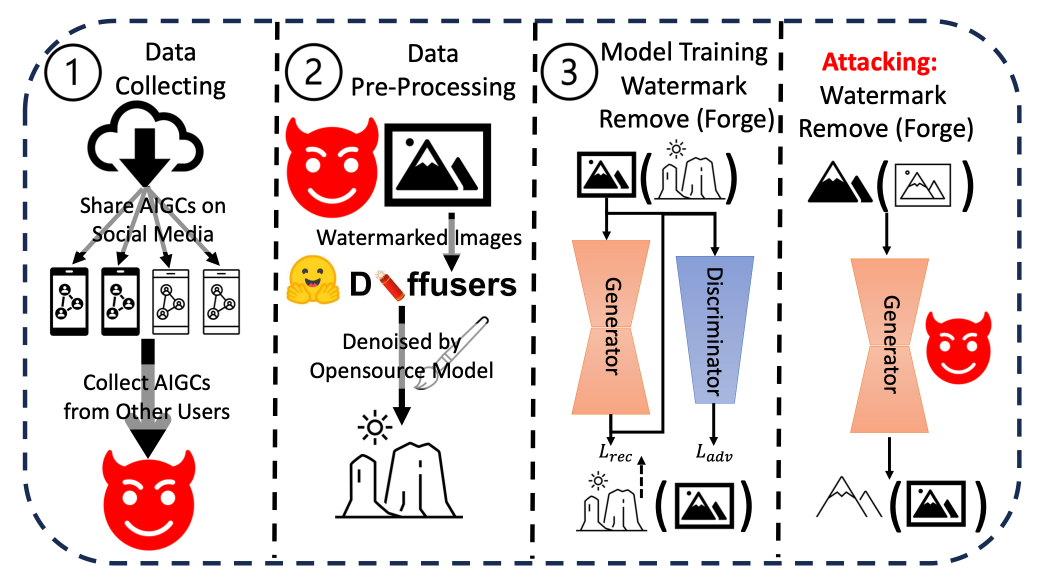

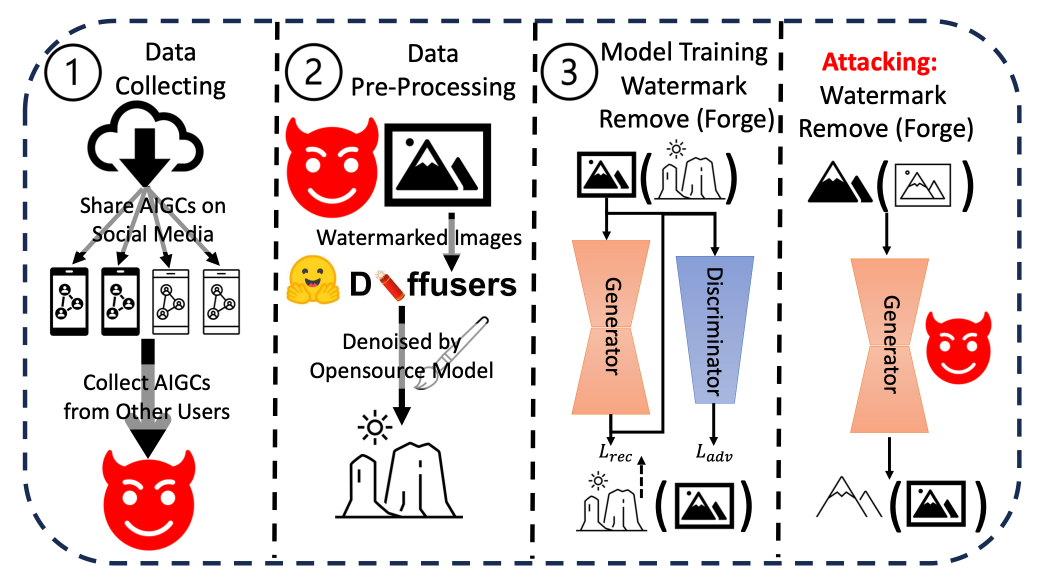

В исследовании использовался процесс атаки. Изображение: Arvix

Кроме того, они оценили потенциальные последствия этих уязвимостей в реальном мире, особенно в сценариях, связанных с дезинформацией или злонамеренным использованием контента, созданного искусственным интеллектом. Совокупные результаты этих экспериментов и анализов привели их к выводу, что существует настоятельная потребность в более надежных механизмах нанесения водяных знаков.

Хотя такие компании, как OpenAI, объявили, что разработали методы обнаружения контента, созданного искусственным интеллектом, с точностью 99%, общая проблема остается. Современные методы идентификации, такие как метаданные и невидимые водяные знаки, имеют свои ограничения.

Ли предполагает, что "лучше комбинировать некоторые методы криптографии, такие как цифровая подпись, с существующими схемами нанесения водяных знаков для защиты AIGC", хотя точная реализация остается неясной.

Другие исследователи предложили более экстремальный подход. Как недавно сообщал Decrypt, команда MIT предложила превратить изображения в “яд” для моделей с искусственным интеллектом. Если в качестве входных данных в обучающем наборе данных использовать “отравленное” изображение, конечная модель даст плохие результаты, поскольку в ней будут обнаружены детали, которые не видны человеческому глазу, но оказывают большое влияние на процесс обучения. Это было бы похоже на смертоносный водяной знак, который убивает модель, которую он обучает.

Стремительный прогресс в области искусственного интеллекта, как подчеркнул генеральный директор OpenAI Сэм Альтман, предполагает будущее, в котором присущие искусственному интеллекту мыслительные процессы могут отражать человеческую логику и интуицию. С такими достижениями потребность в надежных мерах безопасности, таких как нанесение водяных знаков, становится еще более актуальной.

Ли считает, что "водяные знаки и управление контентом необходимы, потому что на самом деле они не повлияют на обычных пользователей", но конфликт между создателями и противниками сохраняется. "Это всегда будет игра в кошки-мышки... Вот почему нам нужно постоянно обновлять наши схемы нанесения водяных знаков. "

"

"